Derivata

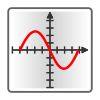

In matematica, la derivata è una funzione che rappresenta il tasso di cambiamento di una data funzione rispetto a una certa variabile, vale a dire la misura di quanto il valore di una funzione cambi al variare del suo argomento. Più informalmente, la derivata misura la crescita (o decrescita) che avrebbe una funzione in uno specifico punto spostandosi di pochissimo dal punto considerato.

La derivata di una funzione in un punto , nel caso di funzioni a una variabile nel campo reale, corrisponde alla pendenza della retta tangente al grafico della funzione nel punto e ne rappresenta la migliore approssimazione lineare. Nel caso in cui la derivata esista (cioè la funzione sia derivabile) in ogni punto del dominio, la si può vedere a sua volta come una funzione che associa a ogni punto proprio la derivata in quel punto.

Il concetto di derivata è, insieme a quello di integrale, uno dei cardini dell'analisi matematica e del calcolo infinitesimale. Il significato pratico di derivata è il tasso di variazione di una certa grandezza presa in considerazione. Un esempio molto noto di derivata è la variazione della posizione di un oggetto rispetto al tempo, chiamata velocità istantanea.

Descrizione[modifica | modifica wikitesto]

La derivata di una funzione in un punto è il valore del coefficiente angolare della retta tangente alla curva nel punto, cioè la tangente trigonometrica dell'angolo formato dalla tangente in un punto della curva di equazione e l'asse delle ascisse. Se la derivata di una funzione in un punto è , la retta tangente al grafico della funzione è parallela all'asse delle ascisse, mentre se il limite mediante cui si calcola la derivata in un punto è infinito la retta tangente al grafico della funzione è parallela all'asse delle ordinate. La funzione derivata si ricava con una serie di operazioni algebriche note come regole di derivazione, applicabili universalmente a tutte le funzioni derivabili.

Nel caso di funzioni di più variabili la tangente in un punto alla curva della funzione non è unica, ma varia a seconda della direzione scelta. Non si può più quindi definire una sola funzione delle stesse variabili indipendenti che renda conto della pendenza del grafico della funzione in un punto: si ricorre allora alle derivate parziali della funzione, cioè ai coefficienti angolari di tangenti considerate lungo direzioni parallele agli assi che rappresentano le variabili indipendenti.

Le derivate parziali sono tante quante il numero delle variabili stesse, e una loro notevole proprietà è che se la funzione è sufficientemente "regolare" (cioè differenziabile) è possibile calcolarne la tangente lungo una direzione qualunque con una combinazione lineare delle derivate parziali stesse. Questo è possibile perché l'operatore di derivazione è un operatore lineare, e quindi la derivata di una combinazione lineare di funzioni derivabili è la combinazione lineare delle derivate delle singole funzioni, e la derivata del prodotto di uno scalare per una funzione è il prodotto dello scalare per la derivata della funzione.

Definizione[modifica | modifica wikitesto]

La nozione di derivata si introduce, nel caso di funzione a una variabile indipendente nel campo reale, considerando una funzione reale di variabile reale e un punto del suo dominio. La derivata di in è definita come il numero uguale al limite del rapporto incrementale al tendere a 0 dell'incremento, sotto l'ipotesi che tale limite esista e sia finito. In modo esplicito, detto l'incremento, una funzione definita in un intorno di si dice derivabile nel punto se esiste ed è finito il limite:

e il valore di questo limite è la derivata della funzione nel punto . Se la funzione è derivabile in ogni punto di un dato intervallo , allora si dice che essa è derivabile in e la funzione che associa a ogni punto la derivata di è la funzione derivata di .

Derivata complessa[modifica | modifica wikitesto]

Nonostante il caso più semplice sia quello delle funzioni reali, la definizione di derivata trova la sua collocazione più naturale nell'ambito dell'analisi complessa, dove, applicata alle funzioni di variabile complessa, prende il nome di derivata complessa.[1] Detto un sottoinsieme aperto del piano complesso, una funzione complessa è differenziabile in senso complesso in un punto se esiste il limite:[2]

Tale limite va inteso in relazione alla topologia del piano. In altre parole, per ogni successione di numeri complessi che converge a , il rapporto incrementale deve tendere a un medesimo numero, indicato con Se è differenziabile in senso complesso in ogni punto , si dice che è una funzione olomorfa su .

Relazione tra derivata reale e complessa[modifica | modifica wikitesto]

La relazione tra la differenziabilità di funzioni reali e funzioni complesse è data dal fatto che se una funzione complessa:

è olomorfa allora e possiedono derivata parziale prima rispetto a e e soddisfano le equazioni di Cauchy-Riemann:[3]

In modo equivalente, la derivata di Wirtinger di rispetto al complesso coniugato di è nulla.

Derivata destra e derivata sinistra[modifica | modifica wikitesto]

La derivata destra di in è il numero:

Analogamente, la derivata sinistra di in è il numero:

Una funzione è derivabile in se e solo se esistono finite e uguali le derivate destra e sinistra. Queste permettono inoltre di definire la derivabilità su un intervallo non aperto: se è definita ad esempio nell'intervallo chiuso , si dice che è derivabile in se è derivabile in ogni punto interno e se esistono le derivate destra e sinistra rispettivamente negli estremi e .

Le derivate destre e sinistre sono un caso particolare in della derivata direzionale di Dini nelle direzioni parallele e versi concordi a e (per rispettivamente derivata destra e sinistra). Infatti in tutti i punti, visti come vettori in uno spazio vettoriale di dimensione , sono paralleli e possono essere solo di verso concorde o discorde.

Notazioni[modifica | modifica wikitesto]

La prima notazione di derivata nel punto che compare storicamente è:

ancora oggi usata in fisica. In alternativa, secondo la notazione di Lagrange viene indicata con:

secondo la notazione di Cauchy-Eulero con:

o più recentemente, per sottolineare che la derivata ha come argomento una funzione e non un punto, con

secondo la notazione di Leibniz con:

e secondo la notazione di Newton con:

Derivata parziale[modifica | modifica wikitesto]

Nel caso di una funzione di più variabili, l'incremento della funzione rispetto a una sola variabile è la derivata parziale della funzione rispetto a tale variabile. Data una funzione vettoriale di più variabili definita su un insieme aperto dello spazio euclideo , dette e le basi canoniche di e rispettivamente, la funzione può essere scritta nel seguente modo:

La componente -esima della funzione è allora:

Si definisce derivata parziale di rispetto alla variabile il limite:[4]

Tale limite è a volte chiamato limite del rapporto incrementale di nel punto , e viene denotato anche con . La derivata parziale di una funzione, o nel caso di funzione vettoriale di una sua componente, si effettua quindi considerando le variabili diverse da quella rispetto a cui si vuole derivare come costanti e calcolandone il rapporto incrementale.

Derivata direzionale[modifica | modifica wikitesto]

La derivata direzionale di una funzione scalare lungo un vettore unitario è la funzione definita dal limite:

Se la funzione è differenziabile in , allora la derivata direzionale esiste lungo ogni vettore unitario e si ha:[5]

dove al secondo membro rappresenta il gradiente di e il prodotto scalare euclideo. In la derivata direzionale di rappresenta la variazione di lungo .

Generalizzazioni della derivata[modifica | modifica wikitesto]

Differenziabilità di una funzione[modifica | modifica wikitesto]

Una funzione differenziabile in un punto è una funzione che può essere approssimata da una trasformazione lineare nel punto. Affinché ciò si verifichi è necessario che tutte le derivate parziali calcolate nel punto esistano, ovvero esistono finiti i limiti dei rapporti incrementali direzionali (dunque, se una funzione è differenziabile in un punto allora è derivabile nel punto). La proprietà di differenziabilità di una funzione consente di generalizzare il concetto di funzione derivabile a funzioni vettoriali di variabile vettoriale, e permette di individuare per ogni punto del suo grafico un iperpiano tangente.

Una funzione definita su un insieme aperto dello spazio euclideo è detta differenziabile in un punto del dominio se esiste una applicazione lineare tale che valga l'approssimazione:

dove si annulla all'annullarsi dell'incremento . Tale condizione si può scrivere in modo equivalente:

Se la funzione è differenziabile in , l'applicazione è rappresentata dalla matrice jacobiana .

Il vettore:

si chiama differenziale di in e è la derivata totale della funzione .

La funzione è infine differenziabile se lo è in ogni punto del dominio.[6] In particolare, il teorema del differenziale totale afferma che una funzione è differenziabile in un punto se tutte le derivate parziali esistono in un intorno del punto per ogni componente della funzione e se sono inoltre funzioni continue. Se inoltre l'applicazione che associa a è continua, la funzione si dice differenziabile con continuità.[7]

Continuità e derivabilità[modifica | modifica wikitesto]

Il teorema di continuità asserisce che se è derivabile in allora è anche continua in .

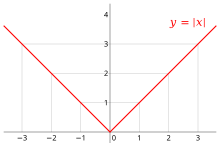

Non vale il teorema che si ottiene invertendo le ipotesi con le tesi: ad esempio, la funzione è continua su tutto il dominio, ma non è derivabile nel punto , perché limite destro e limite sinistro del rapporto incrementale non coincidono. La continuità di una funzione è quindi condizione necessaria, ma non sufficiente, per determinarne la derivabilità. Una funzione può inoltre essere derivabile (e quindi continua) in un punto , ma essere discontinua in ogni punto intorno a . Questo accade per funzioni come:

essendo l'insieme dei numeri razionali e l'insieme dei numeri reali, mentre il simbolo "\" denota la differenza tra insiemi. La funzione in esame ammette derivata in (vale il limite del rapporto incrementale) ma non è continua in nessun punto eccetto lo . Notiamo che se invece una funzione è due volte derivabile in un punto, allora è continua in un intorno di quel punto.

Per mostrare che se è derivabile in allora è continua in , si considera l'uguaglianza precedente:

da cui:

Quindi la funzione è continua in . La stima lineare della funzione attorno a costituisce una migliore approssimazione rispetto a:

garantita dalla sola continuità (qui ). Se la funzione è derivabile in si può "scomporre" l'infinitesimo in un termine lineare e un infinitesimo di ordine superiore. Il teorema di Lagrange fornisce una diversa approssimazione (sempre lineare) nell'ipotesi che la funzione sia derivabile in un intorno di :

per tutti gli in tale intorno, e con un dato punto in (o , se è un intorno sinistro). Benché ora l'approssimazione sia "esatta" (non ci sono termini infinitesimi che vengono trascurati), il teorema non è in grado di mostrare per quale sia vera l'uguaglianza.

Funzioni non derivabili[modifica | modifica wikitesto]

Una funzione continua può essere non derivabile. Ad esempio, una funzione continua può non essere derivabile in un punto isolato del dominio, in presenza di un punto angoloso, una cuspide o un flesso a tangente verticale. Esistono anche funzioni continue che presentano forme più complesse di non derivabilità, come ad esempio la funzione di Cantor. La funzione di Weierstrass è una funzione reale di variabile reale che ha la proprietà di essere continua in ogni punto ma di non essere derivabile in nessuno.

Teoremi[modifica | modifica wikitesto]

Vengono enunciati di seguito alcuni teoremi e risultati significativi.

Regole di derivazione[modifica | modifica wikitesto]

Siano e funzioni reali di variabile reale derivabili, e sia l'operazione di derivazione rispetto a :

- Regola del prodotto (o di Leibniz):

- con:

Teorema di Fermat[modifica | modifica wikitesto]

Sia una funzione derivabile, e quindi continua, in un punto interno al dominio. Se è un punto di massimo o di minimo per la funzione allora la derivata della funzione in è nulla, cioè .

Non è indispensabile che sia interno al dominio, essendo sufficiente che si tratti di un punto di accumulazione da destra e da sinistra per il dominio, mentre è essenziale porre che la funzione sia derivabile nel punto in quanto non è possibile dedurne la derivabilità dalle altre ipotesi del teorema. Ogni punto in cui si annulla (cioè è uguale a zero) è chiamato punto stazionario. I massimi e minimi relativi sono chiamati punti stazionari di .

Questo teorema è molto usato nello studio di funzione, in quanto definisce la possibilità di avere un punto di massimo o di minimo dove la funzione derivata si annulla.

Teorema di Rolle[modifica | modifica wikitesto]

Sia una funzione continua nell'intervallo chiuso e derivabile nell'intervallo aperto . Se allora esiste almeno un punto in cui la derivata prima si annulla.

Teorema di Lagrange[modifica | modifica wikitesto]

Sia una funzione continua in e derivabile nell'intervallo aperto . Allora esiste almeno un punto tale per cui:

Il teorema afferma che esiste almeno un punto del grafico della funzione in cui la retta tangente ha coefficiente angolare uguale a quello della corda della retta passante per i punti e . Si tratta di una generalizzazione del teorema di Rolle che analizza il caso in cui è diverso da .

Teorema di Cauchy[modifica | modifica wikitesto]

Siano e funzioni continue in e derivabili in con diversa da 0 per ogni punto dell'intervallo. Allora esiste almeno un punto tale per cui:

Considerando in particolare la funzione , si ottiene l'affermazione del teorema di Lagrange.

Con il teorema di Cauchy è inoltre possibile dimostrare la regola di de l'Hôpital.

Monotonia a partire dalla derivata[modifica | modifica wikitesto]

Sia continua in e derivabile in . Allora:

- Per ogni si ha se e solo se la funzione è crescente in .

- Per ogni si ha se e solo se la funzione è decrescente in .

La funzione può non essere strettamente crescente (o decrescente), e il teorema è direttamente ricavabile dall'enunciato di Lagrange.

Analogamente, valgono anche i fatti seguenti:

- Se per ogni si ha allora la funzione è strettamente crescente in .

- Se per ogni si ha allora la funzione è strettamente decrescente in .

Una funzione strettamente crescente non ha necessariamente derivata ovunque positiva. Ad esempio, è strettamente crescente, ma ha derivata nulla nell'origine, dove c'è un punto di flesso.

Il teorema della funzione costante afferma che una funzione è costante in un intervallo se e solo se è derivabile e la derivata è ovunque nulla nell'intervallo. Mentre la condizione necessaria è conseguenza della definizione di derivata (la derivata di una costante è uguale a zero), la sufficienza segue dal teorema di Lagrange.

Derivate di ordine superiore[modifica | modifica wikitesto]

La derivata -esima di una funzione è la funzione che si ottiene derivando successivamente volte la funzione . Si definiscono così la derivata seconda, terza, e così via; e si usa generalmente una delle seguenti notazioni:

Una funzione derivabile non è necessariamente derivabile volte. Ad esempio, la funzione ha una derivata prima, ma non una seconda: infatti, la derivata di è , che non è a sua volta derivabile nell'origine.

La classe delle funzioni derivabili volte e la cui derivata -esima è continua si indica con .

Convessità[modifica | modifica wikitesto]

Sia derivabile. Allora è convessa se e solo se è crescente in . Se possiede derivata seconda, allora la convessità della funzione è data dalla disequazione:

Il cambiamento di segno della derivata seconda determina quindi un cambiamento di convessità della funzione e un relativo punto di flesso.

Significato geometrico della derivata[modifica | modifica wikitesto]

Il valore della derivata di calcolata in ha un significato geometrico: è il coefficiente angolare della retta tangente alla curva rappresentata dal grafico di nel punto di coordinate . In altre parole, la derivata è il valore della tangente trigonometrica dell'angolo (convesso) che la retta tangente in al grafico della funzione forma con l'asse delle ascisse (a patto che tale angolo non sia retto).

L'equazione della retta tangente in risulta:

Più precisamente, se è derivabile nel punto , allora esiste una funzione definita in un intorno di tale che:

con:

e tale formula è l'espansione di Taylor di troncata al termine di primo grado. Si dice che è un infinitesimo di ordine superiore alla funzione , e con questo si vuole esprimere l'idea che il termine fornisce un contributo che diventa trascurabile rispetto agli altri termini quando ci si avvicina a . Si può anche dire che una funzione derivabile in è approssimabile linearmente intorno a con la sua retta tangente in tale punto.

Se si definisce infatti , avente lo stesso dominio di , come:

si verifica che:

Ricordando che per allora , e quindi . Sostituendo questa ultima uguaglianza con la precedente equazione si ha:

Esempio[modifica | modifica wikitesto]

Una funzione espressa come serie di potenze con raggio di convergenza è continua e derivabile su tutto l'intervallo . La derivata può essere calcolata derivando termine a termine la serie nel modo seguente:

Tuttavia, in una serie di potenze si preferisce che sia l'indice della potenza, quindi utilizzando uno shift diventa:

Questo tipo di derivata è importante per lo sviluppo di Taylor e Maclaurin.

Note[modifica | modifica wikitesto]

- ^ Weisstein, Eric W. Derivative. From MathWorld, su mathworld.wolfram.com. URL consultato il 25-11-2012.

- ^ Rowland, Todd. Complex Differentiable. From MathWorld, su mathworld.wolfram.com. URL consultato il 25-11-2012.

- ^ Weisstein, Eric W. Cauchy-Riemann Equations. From MathWorld, su mathworld.wolfram.com. URL consultato il 25-11-2012.

- ^ W. Rudin, Pag. 216.

- ^ W. Rudin, Pag. 219.

- ^ W. Rudin, Pag. 214.

- ^ W. Rudin, Pag. 220.

Bibliografia[modifica | modifica wikitesto]

- Paolo Marcellini, Carlo Sbordone: Analisi Matematica Uno, Liguori Editore, 1998, ISBN 9788820728199

- Nicola Fusco, Paolo Marcellini, Carlo Sbordone: Lezioni di Analisi Matematica Due, Zanichelli, 2020, ISBN 9788808520203

- Walter Rudin, Principi di Analisi Matematica, Milano, McGraw-Hill, 1991, ISBN 88-386-0647-1.

- (EN) Abramowitz, M. and Stegun, I. A. (Eds.). Handbook of Mathematical Functions with Formulas, Graphs, and Mathematical Tables, 9th printing. New York: Dover, p. 11, 1972.

- (EN) Amend, B. Camp FoxTrot. Kansas City, MO: Andrews McMeel, p. 19, 1998.

- (EN) Anton, Howard, Calculus: A New Horizon, 6th ed., New York, Wiley, 1999, ISBN 978-04-71153-06-1.

- (EN) Beyer, W. H. Derivatives. CRC Standard Mathematical Tables, 28th ed. Boca Raton, FL: CRC Press, pp. 229–232, 19

Voci correlate[modifica | modifica wikitesto]

- Approssimazione lineare

- Classe C di una funzione

- Derivata mista

- Derivata parziale

- Derivata direzionale

- Derivata simmetrica

- Derivata totale

- Derivazione complessa

- Funzione differenziabile

- Funzione olomorfa

- Generalizzazioni della derivata

- Gradiente

- Integrale

- Matrice jacobiana

- Notazione per la differenziazione

- Rapporto incrementale

- Regole di derivazione

- Sviluppo di Taylor

Altri progetti[modifica | modifica wikitesto]

Wikibooks contiene testi o manuali sulla derivata

Wikibooks contiene testi o manuali sulla derivata Wikizionario contiene il lemma di dizionario «derivata»

Wikizionario contiene il lemma di dizionario «derivata» Wikiversità contiene risorse sulla derivata

Wikiversità contiene risorse sulla derivata

Collegamenti esterni[modifica | modifica wikitesto]

- derivata, su Treccani.it – Enciclopedie on line, Istituto dell'Enciclopedia Italiana.

- derivata, su sapere.it, De Agostini.

- (EN) derivative, su Enciclopedia Britannica, Encyclopædia Britannica, Inc.

- (EN) Eric W. Weisstein, Derivata, su MathWorld, Wolfram Research.

- (EN) Derivata, su Encyclopaedia of Mathematics, Springer e European Mathematical Society.

- WIMS Function Calculator calcolo delle derivate online; questo sito permette anche di fare esercizi interattivi

- Differenziazione calcolatrice, su easycalculation.com.

- (EN) Online Derivatives Calculator.

- Limite, derivate, integrali Directory con varie risorse sulle derivate

| Controllo di autorità | Thesaurus BNCF 32594 · LCCN (EN) sh2011005437 · GND (DE) 4233840-2 · J9U (EN, HE) 987007574837105171 · NDL (EN, JA) 00560650 |

|---|

![{\displaystyle [a,b]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935)

![{\displaystyle \operatorname {D} \left[{f}({x_{0}})\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/51c000bd32ba39e29e922b447f16063d41be0b3d)

![{\displaystyle \mathrm {D} [f(x)]=f'(x),\qquad \mathrm {D} [g(x)]=g'(x).}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9a3dbbee591cfc03840aee7b3156fbb214dc15c9)

![{\displaystyle \mathrm {D} [\alpha f(x)+\beta g(x)]=\alpha f'(x)+\beta g'(x),\qquad \alpha ,\beta \in \mathbb {R} .}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b9a6500ce06fa522a6c5d5a6c9e3b8a2579055ad)

![{\displaystyle \mathrm {D} [{f(x)\cdot g(x)}]=f'(x)\cdot g(x)+f(x)\cdot g'(x).}](https://wikimedia.org/api/rest_v1/media/math/render/svg/74398f82204979f9097b8f0c739a7fb72bf9dd4f)

![{\displaystyle \mathrm {D} \!\left[{f(x) \over g(x)}\right]={f'(x)\cdot g(x)-f(x)\cdot g'(x) \over g(x)^{2}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d36a7e991f16763f9fbe18230d0110dd08bb430e)

![{\displaystyle \mathrm {D} \!\left[{1 \over f(x)}\right]=-{f'(x) \over f(x)^{2}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5eecb4ea4da462882c2f94ebbc84ec29a21d0470)

![{\displaystyle \mathrm {D} [f^{-1}(y)]={1 \over f'(x)},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0e5d1b3f5eeb0973f83e7cc87b3939a44ba93a6f)

![{\displaystyle \mathrm {D} \left[f\left(g(x)\right)\right]=f'\left(g(x)\right)\cdot g'(x).}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2817599e9674d0fc0091e8c197a91595e3e4ff29)

![{\displaystyle f\colon [a,b]\to \mathbb {R} }](https://wikimedia.org/api/rest_v1/media/math/render/svg/c5ab61178bf5349838758ffe3d96135406ed0245)