Teorema di Bayes

Il teorema di Bayes (pronuncia: /beɪz/, ; conosciuto anche come formula di Bayes o teorema della probabilità delle cause), enunciato da Thomas Bayes (1702-1761), discende da due risultati fondamentali della teoria della probabilità: il teorema della probabilità composta e il teorema della probabilità assoluta. Viene impiegato per calcolare la probabilità di una causa che ha provocato l'evento verificato.

Per esempio si può calcolare la probabilità che una certa persona soffra della malattia per cui ha eseguito il test diagnostico (nel caso in cui questo sia risultato negativo) o viceversa non sia affetta da tale malattia (nel caso in cui il test sia risultato positivo), conoscendo la frequenza con cui si presenta la malattia e la percentuale di efficacia del test diagnostico. Formalmente il teorema di Bayes è valido in tutte le interpretazioni della probabilità. In ogni caso, l'importanza di questo teorema per la statistica è tale che la divisione tra le due scuole (statistica bayesiana e statistica frequentista) nasce dall'interpretazione che si dà al teorema stesso.

Enunciato del teorema di Bayes[modifica | modifica wikitesto]

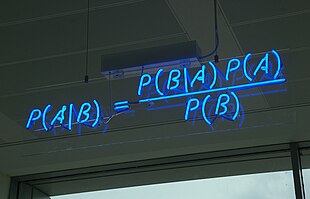

Considerando un insieme di alternative che partizionano lo spazio degli eventi (ossia per ogni e ) ed un evento (di modo che l'evento implichi l'evento per cui si è avverata almeno un'alternativa) tale che si trova la seguente espressione per la probabilità condizionata:

dove:

- è la probabilità a priori o probabilità marginale di "A priori" significa che non tiene conto di nessuna informazione riguardo

- è la probabilità condizionata di noto Viene anche chiamata probabilità a posteriori, visto che è derivata o dipende dallo specifico valore di

- è la probabilità condizionata di noto

- è la probabilità a priori di e funge da costante di normalizzazione.

Intuitivamente, il teorema descrive il modo in cui le opinioni nell'osservare siano arricchite dall'aver osservato l'evento

Un esempio[modifica | modifica wikitesto]

Si consideri una scuola che ha il 60% di studenti maschi e il 40% di studentesse femmine. Le studentesse indossano in egual numero gonne o pantaloni; gli studenti maschi indossano tutti quanti i pantaloni. Un osservatore, da lontano, nota un generico studente coi pantaloni. Qual è la probabilità che quello studente sia una femmina?

Il problema può essere risolto con il teorema di Bayes, ponendo l'evento che lo studente osservato sia femmina, e l'evento che lo studente osservato indossi i pantaloni. Per calcolare dovremo sapere:

- ossia la probabilità che lo studente sia femmina senza nessun'altra informazione. Dato che l'osservatore vede uno studente a caso, ciò significa che tutti gli studenti hanno la stessa probabilità di essere osservati. Essendo le studentesse il 40% del totale, la probabilità risulterà 2/5.

- ossia la probabilità che lo studente sia maschio senza nessun'altra informazione. Essendo l'evento complementare di risulta 3/5.

- ossia la probabilità che uno studente femmina indossi i pantaloni (ossia la probabilità che, verificato l'evento che lo studente sia femmina, si verifichi l'evento che indossi i pantaloni). Poiché indossano gonne e pantaloni in egual numero, la probabilità sarà di 1/2.

- ossia la probabilità che uno studente indossi i pantaloni, noto che lo studente è maschio. Tutti gli studenti maschi indossano i pantaloni, quindi vale 1.

- ossia la probabilità che uno studente qualsiasi (maschio o femmina) indossi i pantaloni. Poiché il numero di coloro che indossano i pantaloni è di 80 (60 maschi + 20 femmine) su 100 studenti fra maschi e femmine, la probabilità è di 80/100 = 4/5.

Ciò detto, possiamo applicare il teorema:

C'è pertanto 1/4 di probabilità che lo studente sia femmina cioè 25%.[1]

Derivazione del teorema[modifica | modifica wikitesto]

Il teorema deriva dalla definizione di probabilità condizionata. La probabilità di un evento noto un evento risulta:

In modo analogo, la probabilità di un evento noto un evento :

Pertanto:

Sostituendo nella prima uguaglianza, si trova il teorema di Bayes:

Applicazioni[modifica | modifica wikitesto]

Applicazione al Problema di Monty Hall[modifica | modifica wikitesto]

Si supponga di partecipare a un gioco a premi, in cui si può scegliere fra tre porte: dietro una di esse c'è un'automobile, dietro le altre, due capre. Si sceglie una porta, diciamo la numero 1, e il conduttore del gioco a premi, che sa cosa si nasconde dietro ciascuna porta, ne apre un'altra, diciamo la 3, rivelando una capra. Quindi domanda: «Vorresti scegliere la numero 2?» Ti conviene cambiare la tua scelta originale?

Si potrebbe pensare che, con due porte chiuse, si abbia una probabilità 50:50 per ognuna, e che quindi non ci sia motivo di cambiare porta. Non è questo il caso. Chiamiamo l'evento che la macchina si trovi dietro una certa porta rispettivamente e

All'inizio, è ovvio che:

Come detto prima, la porta scelta è la numero 1. Chiamiamo l'evento "il presentatore apre la porta 3". Ora:

- Nel caso in cui la macchina sia dietro la porta 1, il presentatore sarà libero di scegliere la porta 2 o 3 casualmente. Pertanto,

- Nel caso in cui la macchina sia dietro la porta 2, il presentatore sarà obbligato ad aprire la porta 3. Pertanto

- Nel caso in cui la macchina sia dietro la porta 3, il presentatore sarà obbligato ad aprire la porta 2. Pertanto

La probabilità a priori per l'evento è del 50%, infatti:

da cui:

Da ciò è evidente che si deve sempre cambiare con la porta 2.

Filtri bayesiani[modifica | modifica wikitesto]

I filtri bayesiani sono uno strumento utilizzato per combattere lo spam che deve il suo funzionamento proprio al teorema di Bayes. Un filtro bayesiano fa uso di un classificatore bayesiano per riconoscere se una certa sequenza di simboli (come una parola) si presenta spesso nei messaggi di spam, quindi applica l'inferenza bayesiana per calcolare la probabilità che un determinato messaggio sia spam.

Storia[modifica | modifica wikitesto]

Il teorema si chiama così in onore del reverendo Thomas Bayes (1702–1761), il quale studiò come calcolare una distribuzione per il parametro di una distribuzione binomiale. Un suo amico, Richard Price, pubblicò il lavoro nel 1763, dopo la morte di Bayes, nell'articolo Essay Towards Solving a Problem in the Doctrine of Chances. Alcuni anni dopo (nel 1774) viene formulato da Pierre Simon Laplace che probabilmente non era a conoscenza del lavoro di Bayes.

Una ricerca pubblicata nel 1983 da parte dal professore di statistica Stephen Stigler, sembrerebbe suggerire che il teorema di Bayes sia stato scoperto dal matematico inglese Nicholas Saunderson (1682-1739) anni prima di Bayes.[2]

La scoperta del teorema di Bayes rimane un argomento controverso nella storia della matematica. Sebbene sia certo che sia stato scoperto prima dell'epoca di Thomas Bayes, ci sono diversi contendenti per la priorità, tra cui Saunderson. All'epoca, gran parte della ricerca matematica veniva svolta attraverso lo scambio di lettere private e discussioni verbali, piuttosto che attraverso le pubblicazioni. Lo storico della statistica Stephen Stigler ha concluso che Saunderson era lo scopritore più probabile dopo aver cercato di rintracciare alcune di queste lettere e discussioni, ma è stato contestato da altri statistici.

Note[modifica | modifica wikitesto]

- ^ La verifica dell'esattezza del risultato, in questo semplice esempio, è immediata se si ricorre alla semplice definizione di "probabilità di un evento" = "numero dei casi favorevoli all'evento/numero dei casi possibili". Il numero dei casi possibili, indossando lo studente (o studentessa) osservato i pantaloni, è di 80 (60 maschi + 20 femmine) mentre quello dei casi favorevoli (cioè le femmine che indossano pantaloni) è 20, quindi la probabilità che si tratti di una femmina è 20/80 cioè 1/4 c.v.d.

- ^ Stephen M. Stigler, Who Discovered Bayes' Theorem?, in The American Statistician, vol. 37, n. 4, 1983, pp. 290–296, DOI:10.1080/00031305.1983.10483122.

Bibliografia[modifica | modifica wikitesto]

Versioni saggistiche[modifica | modifica wikitesto]

- Thomas Bayes (1763), An Essay towards solving a Problem in the Doctrine of Chances. By the late Rev. Mr. Bayes, F. R. S. communicated by Mr. Price, in a letter to John Canton, A. M. F. R. S., Philosophical Transactions, Giving Some Account of the Present Undertakings, Studies and Labours of the Ingenious in Many Considerable Parts of the World, 53:370–418.

- Thomas Bayes (1763/1958), Studies in the History of Probability and Statistics: IX. Thomas Bayes' Essay Towards Solving a Problem in the Doctrine of Chances, Biometrika 45:296–315. (Bayes' essay in modernized notation).

Commenti[modifica | modifica wikitesto]

- G. A. Barnard, Studies in the History of Probability and Statistics: IX. Thomas Bayes' Essay Towards Solving a Problem in the Doctrine of Chances, Biometrika 45:293–295, 1958

- Daniel Covarrubias, An Essay Towards Solving a Problem in the Doctrine of Chances

- Stephen M. Stigler, Thomas Bayes' Bayesian Inference, Journal of the Royal Statistical Society, Series A, 145:250–258, 1982

- Isaac Todhunter, A History of the Mathematical Theory of Probability from the time of Pascal to that of Laplace, Macmillan, 1865. Ristampa 1949, 1956 by Chelsea e 2001 by Thoemmes.

Voci correlate[modifica | modifica wikitesto]

- Probabilità

- Probabilità condizionata

- Teorema della probabilità composta

- Teorema della probabilità assoluta

- Paradosso dei corvi

- Problema di Monty Hall

- Paradosso delle tre carte

- Paradosso dei due bambini

- Inferenza bayesiana

- Thomas Bayes

- Pierre Simon Laplace

- Diagnosi

Altri progetti[modifica | modifica wikitesto]

Wikimedia Commons contiene immagini o altri file sul teorema di Bayes

Wikimedia Commons contiene immagini o altri file sul teorema di Bayes

Collegamenti esterni[modifica | modifica wikitesto]

- Giacomo Aletti, Teorema di Bayes, in Enciclopedia della scienza e della tecnica, Istituto dell'Enciclopedia Italiana, 2007-2008.

- (EN) Richard Routledge, Bayes’s theorem, su Enciclopedia Britannica, Encyclopædia Britannica, Inc.

- (EN) Teorema di Bayes, su Stanford Encyclopedia of Philosophy.

- (EN) Eric W. Weisstein, Bayes' Theorem, su MathWorld, Wolfram Research.

| Controllo di autorità | Thesaurus BNCF 73793 · GND (DE) 4144221-0 |

|---|