Distribuzione  |

|---|

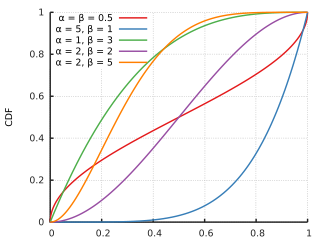

Funzione di densità di probabilità

|

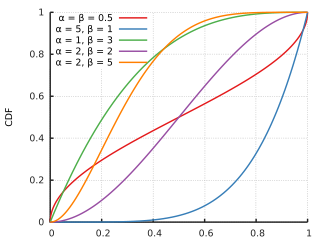

Funzione di ripartizione

|

| Parametri |

|

|---|

| Supporto | ![{\displaystyle [0,1]\ }](https://wikimedia.org/api/rest_v1/media/math/render/svg/b790e70aca2e6d4d4f4d6d2a743575014f855d61)

|

|---|

| Funzione di densità |

|

|---|

| Funzione di ripartizione |

(funzione Beta incompleta regolarizzata)

|

|---|

| Valore atteso |

|

|---|

| Moda |  se se

se se  e e

se se  e e

|

|---|

| Varianza |

|

|---|

| Indice di asimmetria |

|

|---|

| Funzione generatrice dei momenti |

|

|---|

| Funzione caratteristica |

|

|---|

| Manuale |

In teoria delle probabilità e in statistica, la distribuzione  (Beta) è una distribuzione di probabilità continua definita da due parametri

(Beta) è una distribuzione di probabilità continua definita da due parametri  e

e  sull'intervallo unitario

sull'intervallo unitario ![{\displaystyle [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/738f7d23bb2d9642bab520020873cccbef49768d) .

.

Questa distribuzione nasce in modo molto naturale nella inferenza bayesiana, perché governa la probabilità  di un processo di Bernoulli a posteriori dell'osservazione di

di un processo di Bernoulli a posteriori dell'osservazione di  "successi" e

"successi" e  "fallimenti", quando

"fallimenti", quando  è a priori distribuita uniformemente tra

è a priori distribuita uniformemente tra  e

e  .

.

La distribuzione Beta di parametri  (entrambi positivi) è definita sull'intervallo

(entrambi positivi) è definita sull'intervallo ![{\displaystyle [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/738f7d23bb2d9642bab520020873cccbef49768d) con funzione di densità di probabilità

con funzione di densità di probabilità

.

.

In altri termini la funzione di densità di probabilità è proporzionale alla funzione

,

,

riscalata per un fattore dato dalla funzione Beta

;

;

in questo modo ha probabilità totale ![{\displaystyle P(X\in [0,1])=1}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a4ed41777dae33483e880d9e88be739217965521) .

.

La sua funzione di ripartizione è la funzione Beta incompleta regolarizzata

.

.

I momenti semplici di una variabile aleatoria  con distribuzione Beta di parametri

con distribuzione Beta di parametri  sono

sono

![{\displaystyle \mu _{k}=E[X^{k}]={\frac {\int _{0}^{1}x^{\alpha +k-1}(1-x)^{\beta -1}dx}{\int _{0}^{1}x^{\alpha -1}(1-x)^{\beta -1}dx}}={\frac {\mathrm {B} (\alpha +k,\beta )}{\mathrm {B} (\alpha ,\beta )}}={\frac {(\alpha )_{k}}{(\alpha +\beta )_{k}}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/605467f8f040cd3f0e3c7f6411499257a46dcd53) ,

,

dove  indica il fattoriale crescente con k fattori,

indica il fattoriale crescente con k fattori,  .

(L'ultima uguaglianza può essere dedotta dall'espressione della funzione Beta attraverso la funzione Gamma,

.

(L'ultima uguaglianza può essere dedotta dall'espressione della funzione Beta attraverso la funzione Gamma,  e dalla proprietà

e dalla proprietà  .)

.)

I momenti semplici soddisfano quindi la relazione ricorsiva

.

.

In particolare, la distribuzione ha:

- valore atteso

![{\displaystyle E[X]={\frac {\alpha }{\alpha +\beta }}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9474e3dfc28e7895993e7cfd418a8b291a2ac184) ;

;

- varianza

;

;

- indice di asimmetria

;

;

- indice di curtosi

.

.

Invertendo le relazioni qui sopra, che forniscono il valore atteso e la varianza in funzione dei parametri  e

e  , possiamo esprimere univocamente i suddetti parametri in termini del valore atteso e della varianza:

, possiamo esprimere univocamente i suddetti parametri in termini del valore atteso e della varianza:

![{\displaystyle \alpha =E[X]\left({\frac {E[X](1-E[X])}{{\text{Var}}(X)}}-1\right)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/03acbec1c3489eb16bdd60a2cecf87f031ffa850) ;

;![{\displaystyle \beta =(1-E[X])\left({\frac {E[X](1-E[X])}{{\text{Var}}(X)}}-1\right)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/af0e6129b57f375167c47e3900f64182c63216e6) .

.

Queste formule vengono applicate nel metodo dei momenti, con la media e la varianza osservate su un campione.

L'entropia è

,

,

dove  è la funzione digamma.

è la funzione digamma.

La moda della distribuzione dipende dai segni di  e

e  , ed è unica solo se almeno uno dei due è positivo:

, ed è unica solo se almeno uno dei due è positivo:

- se

e

e  allora la moda è

allora la moda è  ;

;

- se

(o

(o  ) e

) e  allora la moda è 1;

allora la moda è 1;

- se

(o

(o  ) e

) e  allora la moda è 0.

allora la moda è 0.

(La funzione di densità di probabilità ha un asintoto in 0 se  , in 1 se

, in 1 se  .)

.)

Una distribuzione Beta può essere definita su un qualunque intervallo ![{\displaystyle [a,b]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935) , costruendo una nuova variabile casuale

, costruendo una nuova variabile casuale  .

.

Se  segue la distribuzione Beta di parametri

segue la distribuzione Beta di parametri  allora

allora  segue la distribuzione Beta di parametri

segue la distribuzione Beta di parametri  .

.

- La distribuzione di Dirichlet è una generalizzazione della distribuzione Beta: essa descrive la distribuzione a posteriori dei parametri di una distribuzione multinomiale a posteriori, appunto, di un'osservazione. La distribuzione di Dirichlet con due parametri è esattamente la distribuzione Beta.

- Per

la densità di probabilità del tipo Beta

la densità di probabilità del tipo Beta  è, in termini geometrici, la metà superiore di una circonferenza:

è, in termini geometrici, la metà superiore di una circonferenza:  , descrive un semicerchio. La variabile aleatoria

, descrive un semicerchio. La variabile aleatoria  segue una distribuzione di Wigner di parametro r.

segue una distribuzione di Wigner di parametro r.

- Se

e

e  sono due variabili aleatorie indipendenti con distribuzioni Gamma di rispettivi parametri

sono due variabili aleatorie indipendenti con distribuzioni Gamma di rispettivi parametri  e

e  , allora la variabile aleatoria

, allora la variabile aleatoria  segue la distribuzione Beta di parametri

segue la distribuzione Beta di parametri  .

.

- Se la variabile aleatoria

segue la distribuzione Beta di parametri

segue la distribuzione Beta di parametri  allora la variabile aleatoria

allora la variabile aleatoria  è descritta dalla distribuzione Beta del secondo tipo, che ha funzione di densità di probabilità

è descritta dalla distribuzione Beta del secondo tipo, che ha funzione di densità di probabilità

- La distribuzione di Wilks

può essere interpretata come la distribuzione che governa il prodotto

può essere interpretata come la distribuzione che governa il prodotto  di n variabili aleatorie indipendenti

di n variabili aleatorie indipendenti  con rispettivi parametri

con rispettivi parametri  .

.

- Se

è una variabile aleatoria con distribuzione di Kumaraswamy di parametri

è una variabile aleatoria con distribuzione di Kumaraswamy di parametri  allora

allora  segue la distribuzione Beta di parametri

segue la distribuzione Beta di parametri  .

.

La distribuzione Beta e il processo di Bernoulli[modifica | modifica wikitesto]

E' immediato dimostrare che, se X è distribuita come una v.c. binomiale

con parametri n e π

e il parametro π è distribuito a priori come una v.c. Beta con i parametri a e b

allora il parametro π è distribuito a posteriori, anch'esso, come una v.c. Beta, ma con parametri a+x e b+n-x

Come detto in precedenza, qualora il parametro π sia distribuito a priori come una variabile casuale rettangolare nell'intervallo [0;1] (ovvero ipotizzando a priori tutti i possibili valori di π equiprobabili), e pertanto a=1 e b=1, allora la distribuzione a posteriori del parametro π è una Beta con parametri x+1 e n-x+1

essa ha come valore modale p

, che corrisponde alla stima usata in ambito frequentistico, mentre il valore atteso o media, è

, che corrisponde alla stima usata in ambito frequentistico, mentre il valore atteso o media, è

, che per x<n/2 è maggiore del valore modale

, che per x<n/2 è maggiore del valore modale  . Il valore atteso minimizza lo scarto quadratico.

. Il valore atteso minimizza lo scarto quadratico.

Infatti, la probabilità di ottenere  successi e

successi e  fallimenti in un processo di Bernoulli di parametro p è

fallimenti in un processo di Bernoulli di parametro p è  , proporzionale alla densità

, proporzionale alla densità  della distribuzione Beta di parametri

della distribuzione Beta di parametri  .

.

Pertanto, come detto sopra, se la variabile aleatoria  segue una distribuzione binomiale

segue una distribuzione binomiale  con parametro aleatorio P distribuito a priori uniformemente sull'intervallo unitario

con parametro aleatorio P distribuito a priori uniformemente sull'intervallo unitario ![{\displaystyle [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/738f7d23bb2d9642bab520020873cccbef49768d) , a posteriori dell'osservazione

, a posteriori dell'osservazione  il parametro P segue la distribuzione

il parametro P segue la distribuzione  .

.

Più in generale, se  è una variabile aleatoria con distribuzione binomiale

è una variabile aleatoria con distribuzione binomiale  e il parametro P segue a priori la distribuzione

e il parametro P segue a priori la distribuzione  , allora a posteriori dell'osservazione

, allora a posteriori dell'osservazione  il parametro P segue la distribuzione

il parametro P segue la distribuzione  .

.

Il caso della distribuzione uniforme a priori è un caso particolare di quest'ultimo, essendo  .

.

Se X è distribuita come una v.c. binomiale negativa

con parametri m e θ

e il parametro θ è distribuito a priori come una v.c. Beta con i parametri a e b

allora il parametro θ è distribuito a posteriori anch'esso come una v.c. Beta, ma con parametri a+m e b+x

Qualora la distribuzione a priori sia una variabile casuale rettangolare nell'intervallo [0;1] (ovvero ipotizzando a priori tutti i possibili valori di θ equiprobabili), e pertanto a=1 e b=1, allora la distribuzione a posteriori è una Beta con parametri m+1 e x+1

che ha come valore modale t

- t=m/(m+x)

Similmente, se la variabile aleatoria  segue la distribuzione di Pascal

segue la distribuzione di Pascal  e P segue a priori la distribuzione

e P segue a priori la distribuzione  , allora a posteriori dell'osservazione

, allora a posteriori dell'osservazione  il parametro P segue la distribuzione

il parametro P segue la distribuzione  .

.

Wikimedia Commons contiene immagini o altri file su Distribuzione Beta

Wikimedia Commons contiene immagini o altri file su Distribuzione Beta

![{\displaystyle [0,1]\ }](https://wikimedia.org/api/rest_v1/media/math/render/svg/b790e70aca2e6d4d4f4d6d2a743575014f855d61)

![{\displaystyle [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/738f7d23bb2d9642bab520020873cccbef49768d)

![{\displaystyle P(X\in [0,1])=1}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a4ed41777dae33483e880d9e88be739217965521)

![{\displaystyle \mu _{k}=E[X^{k}]={\frac {\int _{0}^{1}x^{\alpha +k-1}(1-x)^{\beta -1}dx}{\int _{0}^{1}x^{\alpha -1}(1-x)^{\beta -1}dx}}={\frac {\mathrm {B} (\alpha +k,\beta )}{\mathrm {B} (\alpha ,\beta )}}={\frac {(\alpha )_{k}}{(\alpha +\beta )_{k}}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/605467f8f040cd3f0e3c7f6411499257a46dcd53)

![{\displaystyle E[X]={\frac {\alpha }{\alpha +\beta }}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9474e3dfc28e7895993e7cfd418a8b291a2ac184)

![{\displaystyle \alpha =E[X]\left({\frac {E[X](1-E[X])}{{\text{Var}}(X)}}-1\right)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/03acbec1c3489eb16bdd60a2cecf87f031ffa850)

![{\displaystyle \beta =(1-E[X])\left({\frac {E[X](1-E[X])}{{\text{Var}}(X)}}-1\right)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/af0e6129b57f375167c47e3900f64182c63216e6)

![{\displaystyle [a,b]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935)

![{\displaystyle {\mathcal {U}}([0,1])}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b8848783322f2c9cbbe8996919e4650686163431)