Big data

In statistica e informatica, la locuzione inglese big data ("grandi [masse di] dati") o talvolta l'italiana megadati[1][2][3] indicano genericamente una raccolta di dati informatici così estesa in termini di volume, velocità e varietà da richiedere tecnologie e metodi analitici specifici per l'estrazione di valore o conoscenza[4]. Il termine è utilizzato dunque in riferimento alla capacità (propria della scienza dei dati) di analizzare ovvero estrapolare e mettere in relazione un'enorme mole di dati eterogenei, strutturati e non strutturati (grazie a sofisticati metodi statistici e informatici di elaborazione), al fine di scoprire i legami tra fenomeni diversi (ad esempio correlazioni) e prevedere quelli futuri. I big data possono essere utilizzati per diversi scopi tra cui quello di misurare le prestazioni di un'organizzazione nonché di un processo aziendale.[5]

Descrizione[modifica | modifica wikitesto]

Malgrado non esista una separazione rigorosa tra big data e altri dati (non classificabili come big), sono stati proposti diversi approcci per descriverne le peculiarità. Nel 2011 Teradata afferma che «Un sistema di big data eccede/sorpassa/supera i sistemi hardware e software comunemente usati per catturare, gestire ed elaborare i dati in un lasso di tempo ragionevole per una comunità/popolazione di utenti anche massiva». Un'ulteriore proposta di caratterizzazione dei big data è stata data dal McKinsey Global Institute: «Un sistema di Big Data si riferisce a dataset la cui taglia/volume è talmente grande che eccede la capacità dei sistemi di database relazionali di catturare, immagazzinare, gestire ed analizzare».

Per poter parlare di big data il volume dei dati deve essere correlato alla capacità del sistema di acquisire le informazioni così come arrivano dalle differenti sorgenti dati che sono adoperate, quindi, un sistema diventa big quando aumenta il volume dei dati e allo stesso tempo aumenta la velocità/flusso di informazioni al secondo che il sistema deve poter acquisire e gestire. Negli ultimi due anni c'è stato infatti un incremento del 90% dei dati prodotti nel mondo e le aziende potrebbero arrivare a produrre zettabyte di dati, ad esempio considerando dati provenienti da sensori, dati satellitari, finanziari, telefonici, ecc.

Il progressivo aumento della dimensione dei dataset è legato alla necessità di analisi su un unico insieme di dati, con l'obiettivo di estrarre informazioni aggiuntive rispetto a quelle che si potrebbero ottenere analizzando piccole serie, con la stessa quantità totale di dati. Ad esempio, l'analisi per sondare gli "umori" dei mercati e del commercio, e quindi del trend complessivo della società e del fiume di informazioni che viaggiano e transitano attraverso Internet. Con i big data la mole dei dati è dell'ordine degli zettabyte, ovvero miliardi di terabyte,[6] quindi si richiede una potenza di calcolo parallelo e massivo con strumenti dedicati eseguiti su decine, centinaia o anche migliaia di server.[7][8] I Big data comportano anche l'interrelazione di dati provenienti da fonti potenzialmente eterogenee, cioè non soltanto i dati strutturati (come quelli provenienti dai database) ma anche non strutturati (immagini, email, dati GPS, informazioni derivanti dai social network, ecc.).

Definizione e caratteristiche[modifica | modifica wikitesto]

Non esiste una soglia di riferimento prestabilita in termini di dimensione oltre la quale è lecito parlare di Big Data: in genere si parla di big data quando l'insieme di dati è talmente grande e complesso che richiede la definizione di nuovi strumenti e metodologie per estrapolare, gestire e processare informazioni entro un tempo ragionevole.[9] Infatti, come enunciato dalla legge di Moore, l'evoluzione tecnologica permette la memorizzazione e la gestione di dataset di dimensioni continuamente crescenti[10]. In uno studio del 2001[11], l'analista Douglas Laney aveva definito il modello di crescita come tridimensionale (modello delle «3V»[12][13]): con il passare del tempo aumentano volume (dei dati), velocità e varietà (dei dati). In molti casi questo modello è ancora valido, nonostante esso sia stato successivamente esteso[14][15][16][17].

Nel primo modello di Douglas Laney, chiamato delle «3V»[13], le tre parole chiave hanno il seguente significato:

- Volume: si riferisce alla quantità di dati (strutturati o non strutturati) generati ogni secondo. Tali dati sono generati da sorgenti eterogenee, quali: sensori, log, eventi[non chiaro], email, social media e database tradizionali;

- Varietà: si riferisce alla differente tipologia dei dati che vengono generati, accumulati ed utilizzati. Prima dell'epoca dei Big Data si prendevano in considerazione per le analisi principalmente dati strutturati; la loro manipolazione veniva eseguita mediante l'uso di database relazionali. Per avere analisi più accurate e più profonde, oggi è necessario prendere in considerazione anche:

- a) dati non strutturati (ad esempio file di testo generati dalle macchine industriali o log di web server o dei firewall);

- b) dati semi strutturati (ad esempio un atto notarile con frasi fisse e frasi variabili) oltre a quelli strutturati (ad esempio la tabella di un database);

- Velocità: si riferisce alla velocità con cui i nuovi dati vengono generati. Sono importanti non solo la celerità nella generazione dei dati, ma anche la necessità che questi dati/informazioni arrivino in sistema real-time al fine di effettuare analisi su di essi.

Con il tempo, sono state introdotte una quarta V[14][15], quella di veridicità, e poi una quinta, quella di Valore[16][17].

- Veridicità: considerando la varietà dei dati sorgente (dati strutturati o non strutturati) e la velocità alla quale tali dati possono variare, è molto probabile che non si riesca a garantire la stessa qualità di dati in ingresso ai sistemi di analisi normalmente disponibile in processi di ETL tradizionali. È evidente che se i dati alla base delle analisi sono poco accurati, i risultati delle analisi non saranno migliori. Visto che su tali risultati possono essere basate delle decisioni, è fondamentale assegnare un indice di veridicità ai dati su cui si basano le analisi, in modo da avere una misura dell'affidabilità[18].

- Valore: si riferisce alla capacità di trasformare i dati in valore. Un progetto Big Data necessita di investimenti, anche importanti, per la raccolta granulare dei dati e la loro analisi. Prima di avviare un'iniziativa è importante valutare e documentare quale sia il valore effettivo portato al business[16].

Con il passare del tempo, ulteriori caratteristiche si sono aggiunte al modello, quali ad esempio:

- variabilità: questa caratteristica può essere un problema e si riferisce alla possibilità di inconsistenza dei dati;

- complessità: maggiore è la dimensione del dataset, maggiore è la complessità dei dati da gestire.[senza fonte][19][20][21]

Altri modelli concettuali, come il Modello ITMI (Informazione, Tecnologia, Metodi, Impatto)[22][23], hanno cercato di rappresentare in maniera sintetica i vari aspetti che caratterizzano il fenomeno dei big data nella sua complessità, andando oltre le caratteristiche del dato, come avviene per i modelli basati sulle "V".

Crescita del volume dei dati[modifica | modifica wikitesto]

I Big Data sono un argomento interessante per molte aziende[24], le quali negli ultimi anni hanno investito su questa tecnologia più di 15 miliardi di dollari, finanziando lo sviluppo di software per la gestione e l'analisi dei dati. Questo è accaduto perché le economie più forti sono molto motivate all'analisi di enormi quantità di dati: basti pensare che ci sono oltre 4,6 miliardi di smartphone attivi e circa 2 miliardi di persone hanno accesso a Internet. Dal 1986 ad oggi il volume dei dati in circolazione è aumentato in maniera esponenziale:

- nel 1986 i dati erano 281 Petabyte;

- nel 1993 i dati erano 471 PetaByte;

- nel 2000 i dati erano 2,2 Exabyte;

- nel 2007 i dati erano 65 ExaByte;

- per il 2014 si era previsto uno scambio di oltre 650 ExaByte[25][26].

Differenze con la business intelligence[modifica | modifica wikitesto]

La crescente maturità del concetto di Big Data mette in evidenza le differenze con la business intelligence, in materia di dati e del loro utilizzo:

- La business intelligence utilizza la statistica descrittiva con dati ad alta densità d'informazione per misurare cose, rilevare tendenze, ecc., cioè utilizza dataset limitati, dati puliti e modelli semplici;[27]

- Big Data utilizza la statistica inferenziale e concetti di identificazione di sistemi non lineari[28], per dedurre leggi (come regressioni, relazioni non lineari, ed effetti causali) da grandi insiemi di dati[29]; per rivelare rapporti e dipendenze tra essi ed anche per effettuare previsioni di risultati e comportamenti,[28][30] cioè utilizza dataset eterogenei (non correlati tra loro), dati grezzi e modelli predittivi complessi.[27][31]

Modelli di analisi dei dati[modifica | modifica wikitesto]

Come è stato detto in precedenza, il volume di dati dei Big Data e l'ampio uso di dati non strutturati non permette l'utilizzo dei tradizionali sistemi per la gestione di basi di dati relazionali (RDBMS), se non attraverso tecniche di strutturazione del dato. Un dato strutturato archiviato nei tradizionali sistemi RDBMS permette di avere prestazioni infinitamente migliori, nella ricerca, rispetto ai sistemi NoSQL, garantendo la consistenza del dato, che in sistemi Big Data generalmente non è garantita. I sistemi Big Data pertanto non sono da considerarsi complementari alle basi di dati, bensì un insieme di tecniche di ETL su dati non strutturati e generati in maniera geograficamente molto distribuita[non chiaro]. Gli operatori di mercato utilizzano piuttosto sistemi con elevata scalabilità e soluzioni basate sulla NoSQL. Nell'ambito della business analytics sono nati nuovi modelli di rappresentazione in grado di gestire tale mole di dati con elaborazioni in parallelo dei database. Architetture di elaborazione distribuita di grandi insiemi di dati sono offerte da MapReduce di Google e dalla controparte open source Apache Hadoop. In base agli strumenti e ai modelli utilizzati per l'analisi e la gestione dei dati è possibile distinguere quattro metodologie (o tipologie) di Big Data Analytics:

- Analisi descrittiva, l’insieme di strumenti orientati a descrivere la situazione attuale e passata dei processi aziendali e/o aree funzionali. Tali strumenti permettono di accedere ai dati in maniera interattiva (inserendo ad esempio filtri o effettuando operazioni di drill-down) e di visualizzare in modo sintetico e grafico i principali indicatori di prestazione (la totalità delle grandi organizzazioni si serve questa tipologia);

- Analisi predittiva, strumenti avanzati che effettuano l’analisi dei dati per rispondere a domande relative a cosa potrebbe accadere nel futuro (sono caratterizzati da tecniche matematiche quali regressione, proiezione (forecasting), modelli predittivi, ecc.);

- Analisi prescrittiva, strumenti avanzati che, insieme all'analisi dei dati, sono capaci di proporre soluzioni operative/strategiche sulla base delle analisi svolte;

- Automated Analytics, strumenti capaci di implementare autonomamente l’azione proposta secondo il risultato delle analisi svolte.[32]

Tecnologie di immagazzinamento ed elaborazione[modifica | modifica wikitesto]

La crescente mole di dati generati da sorgenti di dati eterogenei ha posto l'attenzione su come estrarli, archiviarli ed utilizzarli al fine di ottenerne un profitto. Il problema che si riscontra è dovuto principalmente alla difficoltà di gestire i Big Data con database tradizionali, sia in termini di costi, sia in termini di volume. L'insieme di questi elementi ha portato allo sviluppo di nuovi modelli di elaborazione, che hanno permesso alle aziende di diventare più competitive, sia attraverso una riduzione dei costi, sia perché i nuovi sistemi sono in grado di archiviare, trasferire e combinare i dati con maggiore velocità e in maniera agile. Per poter gestire il sistema di Big Data si adoperano sistemi che distribuiscono sia risorse che servizi:

- Architetture distribuite: utilizzo di cluster di computer connessi tra loro al fine di cooperare al raggiungimento di un obiettivo comune realizzando la scalabilità orizzontale (non verticale).

- Tolleranza ai guasti: le architetture/piattaforme proposte devono essere progettate per essere tolleranti ai guasti, per questo le risorse sono replicate sulle differenti macchine che compongono il cluster.

- Calcolo distribuito: il modello di elaborazione è distribuito in modo da poter sfruttare la potenza elaborativa del cluster progettato.

Per gestire grandi quantitativi di dati sono state proposte nuove metodologie nei seguenti campi:

A supporto di queste metodologie sono state proposte le seguenti tecnologie e linguaggi di programmazione:

Ciclo di vita[modifica | modifica wikitesto]

L’estrazione di conoscenza dai Big Data e l’impiego della stessa per il miglioramento delle attività decisionali sono subordinati alla definizione di processi che consentano di gestire e trasformare in modo efficiente dataset che crescono rapidamente in volume e varietà. Ogni fase di ciascun processo modifica lo stato ed il contenuto degli stessi, contribuendo a convertire moli di dati ancora grezzi in valore e dunque ad arricchire il modello analitico dei dati[33] [34] [35]. Tali processi costituiscono un riferimento per la scelta o la creazione di un’architettura, ovvero di una struttura logica e fisica che determina come i Big Data devono essere memorizzati, acceduti e gestiti all’interno di un'organizzazione. In essa vengono specificate, inoltre, le soluzioni da mettere in campo per far fronte ai problemi che possono derivare dal trattamento dei Big Data, quali ad esempio la scarsa qualità dei dati o la scalabilità delle infrastrutture, le componenti hardware e software come framework e database, il flusso delle informazioni, la privacy e la sicurezza dei dati e molto altro.

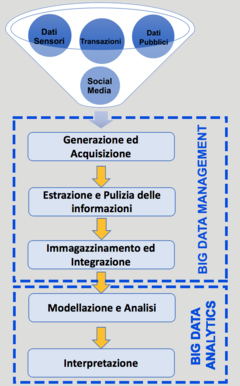

I processi principali che compongono il ciclo di vita dei Big Data possono essere raggruppati in due macro-aree:

- Big Data Management: racchiude i processi e le tecnologie per l’acquisizione e la memorizzazione dei Big Data e la preparazione ed il recupero degli stessi;

- Big Data Analytics: racchiude i processi utilizzati per analizzare e acquisire informazioni utili da grandi dataset allo scopo di interpretare e descrivere il passato (descriptive analytics), predire il futuro (predictive analytics) o consigliare azioni (prescriptive analytics)[36].

Generazione e acquisizione[modifica | modifica wikitesto]

Oltre alla varietà dei formati e strutture, i Big Data presentano anche una varietà di fonti. I dati generati da queste spesso sono classificati in:

- human generated: si trovano e derivano in particolare da piattaforme di social network (Facebook, LinkedIn), blogging (Blogger, Wordpress) e micro-blogging (Twitter, Tumblr), social news (Digg, Reddit), social bookmarking (Delicious, StumbleUpon), multimedia sharing (Instagram, Flickr, YouTube), le wiki (Wikipedia), i siti di domande e risposte (Yahoo Answers), i siti di recensioni (Yelp, TripAdvisor), i portali di e-commerce (eBay, Amazon), click stream[non chiaro] da siti web ecc, generalmente gestiti tramite cookie.

- machine generated: sono prodotti da sorgenti quali sensori GPS, IoT, RFID, centrali di monitoraggio di eventi meteorologici, strumenti scientifici, sistemi di High Frequency Trading dei mercati finanziari, dispositivi biomedicali ed altri.

- business generated: si intendono tutti quei dati, human o machine generated, generati internamente ad un’azienda che registrano tutte le attività data-driven dei processi di business aziendali. Molti di essi sono dati storici, memorizzati staticamente in base di dati relazionali, che rappresentano pagamenti, ordini, dati di produzione, d'inventario, vendite e dati finanziari. La crescente produzione di questa tipologia di dati ha reso necessario l’utilizzo di tecnologie e strumenti di analisi in tempo reale affinché le aziende possano sfruttare a pieno il loro potenziale.

L’acquisizione dei Big Data da questi canali d’informazione può avvenire con diverse modalità:

- Accedendo ad API messe a disposizione dai servizi Web, grazie alle quali è possibile interfacciarsi ad essi per esaminarne i contenuti. Un esempio sono le Twitter API, Facebook Graph API e le API fornite da motori di ricerca come Google e Bing;

- Utilizzando software di web scraping che eseguono operazioni di crawling, parsing ed entity extraction per la raccolta automatica di dati da documenti presenti in Internet. Il framework Apache Tika, ad esempio, automatizza tali operazioni per metadati e testo provenienti da diverse tipologie di documenti, arrivando ad identificarne persino la lingua;

- Importando i dati da database relazionali, non relazionali o da altre sorgenti con strumenti di ETL, già usati ampiamente per la movimentazione di dati in sistemi di Data Warehousing e Data mart. Uno degli strumenti di ETL più usati nell’ottica dei Big Data è Apache Sqoop che consente di importare ed esportare grandi quantità di dati da database relazionali e non verso la piattaforma Apache Hadoop e viceversa;

- Acquisendo flussi continui di dati, rapidamente generati, tramite sistemi capaci di catturare eventi, elaborarli e salvarli su un database in modo efficiente. Tra le tecnologie più diffuse ci sono Apache Flume, Apache Kafka e Microsoft StreamInsight.

In seguito all’acquisizione dalle sorgenti, i dataset sono trasferiti a sistemi di archiviazione locali o remoti attraverso mezzi di trasmissione ad alta velocità. L'insieme di dati grezzi, strutturati e non strutturati, è detto data lake, pronto per l'elaborazione[37]. Inoltre è fondamentale che su di essi vengano eseguite ulteriori operazioni di precompilazione, il cui scopo è filtrare i dati da informazioni ridondanti, inaccurate o incomplete al fine di diminuirne l’entropia (cioè il disordine), migliorando così l’accuratezza delle analisi e riducendo lo spazio necessario alla memorizzazione degli stessi.

Estrazione e pulizia delle informazioni[modifica | modifica wikitesto]

La maggior parte dei dati raccolti non sono disponibili nel formato richiesto per la successiva fase di elaborazione. Ad esempio, il fascicolo informatico di un paziente di un ospedale, nella maggior parte dei casi è costituito da rapporti medici, prescrizioni, letture acquisite da sensori e/o macchine di monitoraggio e dati di immagine come i raggi x. In questo contesto, non è possibile utilizzare questi dati in modo efficace quando ognuno di essi ha una propria rappresentazione. Pertanto, bisogna creare un processo di estrazione che prelevi le informazioni richieste dalla grande fonte dei dati e le rappresenti in una forma standard e strutturata pronta per l'analisi. La progettazione del processo di estrazione dipende principalmente dall'area di applicazione; ad esempio i dati che si estraggono dai supporti utilizzati per la risonanza magnetica sono differenti da quelli utilizzati per le immagini delle stelle. I Big Data, inoltre, possono contenere alcune informazioni false. Ad esempio, i pazienti possono nascondere intenzionalmente alcuni sintomi che possono portare il medico a diagnosticare erroneamente la loro condizione. È necessario, pertanto, utilizzare tecniche di pulizia dei dati che comprendono vincoli per il controllo della validità dei dati e modelli di errore per garantire la loro qualità.

Immagazzinamento e integrazione[modifica | modifica wikitesto]

L’immagazzinamento dei Big Data è un problema che deriva da due necessità: memorizzare ed organizzare enormi dataset non strutturati o semi-strutturati ed allo stesso tempo garantire la loro disponibilità e la capacità di interazione con essi in modo affidabile, veloce e sicuro. Per rispondere a questi bisogni è stato unito allo sviluppo di infrastrutture hardware per l’archiviazione, anche la creazione di meccanismi per la gestione di questi dati, in particolare file system distribuiti e nuove tipologie di database.

L’infrastruttura a supporto dei Big Data consiste in insiemi di nodi di archiviazione ed elaborazione distribuiti in rete, connessi mediante reti di comunicazione ad alta velocità, in grado di scalare orizzontalmente ed essere configurata dinamicamente a seconda delle applicazioni. I file system distribuiti hanno il compito di fornire una visione unificata dell’infrastruttura di memoria distribuita sottostante, fornendo operazioni di base per la lettura e scrittura sequenziale di grandi quantità di dati, assicurando alte prestazioni ed allo stesso tempo un adeguato livello di tolleranza ai guasti. I file system distribuiti più conosciuti sono Google File System (GFS) ed Hadoop Distributed File System (HDFS). Vari tipi di database sono stati proposti negli anni nell’intento di memorizzare, gestire ed organizzare dataset caratterizzati da grandezze, strutture e provenienze diverse. A causa della staticità delle strutture tabellari, le soluzioni basate su RDBMS si sono rivelate inadatte ai requisiti di varietà e volume propri dei Big Data.

L’organizzazione logica dei dati è dunque affidata alle basi di dati NoSQL che abbandonano le restrizioni imposte dal modello relazionale e dal linguaggio SQL ma che invece possiedono caratteristiche fondamentali per i Big Data come l’essere "schemaless" e distribuite, avere una facile replicazione dei dati, eventual consistency e, non ultimo, il supporto per lo memoria persistente di grandi moli di dati. Alla fase di immagazzinamento viene affiancata spesso una fase di integrazione che consiste in ulteriori elaborazioni e trasformazioni dei dati per prepararli alla successiva fase di analisi. Ciò permette di ottenere una visione unificata e normalizzata dei dati. Le operazioni che vengono svolte più frequentemente in questa fase sono l’unione di dati da database esterni ed il riconoscimento di contenuti testuali da documenti provenienti da fonti come il Web o le repository aziendali.

Modellazione, elaborazione e analisi[modifica | modifica wikitesto]

Lo scopo della fase di analisi è quello di estrarre valore in forma di conoscenza dai Big Data, esaminando gli enormi dataset a disposizione alla scoperta di correlazioni, trend, pattern ed ulteriori indici statistici nascosti nei dati. Le analisi possono essere eseguite su dati strutturati, semi-strutturati e non strutturati, tra cui:

- Analisi di testi: l’estrazione di informazioni e conoscenza a partire da testo non strutturato contenuto in documenti, email, pagine Web e post su blog e social network, nota anche come text mining, fa principalmente uso di tecniche di Natural language processing (NLP), machine learning ed analisi statistica. Grazie ad esse sono stati sviluppati algoritmi per il riconoscimento di argomenti (topic modeling), la ricerca delle migliori risposte ad una domanda (question answering), l’individuazione delle opinioni degli utenti su determinate notizie (opinion mining) ed altri ancora;

- Analisi di dati multimediali: la natura non strutturata di contenuti multimediali quali immagini, video ed audio, la loro dimensione, eterogeneità ed il fatto di essere prodotti molto rapidamente rendono idonea la loro trattazione con sistemi di Big Data Analytics. Algoritmi di machine learning permettono di estrarre informazioni di basso ed alto livello utili alla descrizione semantica dei file multimediali. L’annotazione automatica tramite etichette testuali (multimedia annotation) e l’estrazione di feature visive o sonore (feature extraction) sono attività alla base di algoritmi d’indicizzazione (multimedia indexing) e raccomandazione (multimedia recommendation) di questi contenuti.

- Analisi del Web: è possibile ricavare informazioni e conoscenza sui contenuti, la struttura e l’utilizzo del Web analizzando in maniera automatica pagine e collegamenti ipertestuali. L’analisi dei contenuti testuali e multimediali viene svolta facendo uso delle tecniche sopra citate. La topologia può essere ricostruita mediante algoritmi di crawling che seguono i collegamenti ipertestuali per rivelare relazioni tra pagine o siti Web. Uno degli algoritmi più noti che si ispira a tale meccanismo è il PageRank di Google. Il profiling dell’utilizzo del Web da parte di un'utenza sempre più diversificata viene eseguito esaminando un numero elevato di log di server, sessioni, transazioni, ricerche e visite al fine di personalizzare le esperienze individuali degli utenti.

Le tecniche di data mining, machine learning e di analisi statistica come clustering, correlazione e regressione, vengono applicate ai Big Data mediante l’uso di modelli di programmazione e framework di elaborazione distribuita che permettono di ottenere in tempi rapidi aggregati di informazioni dai database NoSQL o da altre fonti, analogamente a ciò che accade per il linguaggio SQL con i database relazionali. Quest’ultimi vengono classificati in base alla tempestività richiesta per le analisi (real time o batch analytics) e alla possibilità di velocizzare parte delle operazioni caricando o meno i dati in memoria primaria (in memory analytics). Fra i modelli di programmazione più diffusi ci sono MapReduce, parte del framework Apache Hadoop, che permette l’elaborazione in batch ed in parallelo di grandi dataset su cluster di macchine general purpose usando l’omonimo paradigma e Google Pregel che consente di eseguire elaborazioni distribuite su enormi grafi che possono rappresentare ad esempio grafi di reti di calcolatori o delle relazioni tra gli utenti di un social network.

Interpretazione dei risultati e assunzione di decisioni[modifica | modifica wikitesto]

L'interpretazione dei parametri analizzati può fornire dei suggerimenti per verificare ipotesi empiriche su fenomeni di interesse, prendere decisioni di business più efficaci, individuare nuovi mercati nei quali investire, sviluppare campagne di marketing scientifico mirate e migliorare l'efficienza operativa.

Controversie[modifica | modifica wikitesto]

Il recente sviluppo di metodologie di acquisizione e di elaborazione di grandi masse di dati tramite algoritmi coinvolge tutti i settori economici ed ha sollevato dubbi sulla loro applicazione in mancanza di adeguate normative e controlli. Nel 2008, in seguito alla crisi economica mondiale, due ingegneri finanziari, Emanuel Derman e Paul Wilmott, hanno elaborato un manifesto etico per gli scienziati dei dati, sul modello del Giuramento di Ippocrate per i medici[38]. Nel 2017 la data scientist Cathy O'Neil ha esposto in un libro le varie problematiche sorte con l'uso dei modelli basati su Big Data. Molti dei quali, lungi dall'essere equi ed obiettivi, si sono dimostrati codificazioni di pregiudizi umani che hanno portato ad errori sistemici senza possibilità di appello nei software che controllano le nostre vite in diversi ambiti, da quello legale a quello lavorativo e politico[39]. Il pericolo di rendere la vita delle persone "calcolabile" sulla base delle tracce che ciascuno lascia in rete, è affrontato in un saggio di Domenico Talia, che discute più in generale dei rischi e delle relazioni tra l’uso dei Big Data, la privacy dei cittadini e l’esercizio della democrazia.[40]

A differenza dell'America Settentrionale, il Parlamento Europeo ha già varato un Regolamento generale sulla protezione dei dati[41]. Secondo Kevin Kelly, «se si vuole modificare il comportamento in Rete delle persone, basta semplicemente alterare sullo schermo gli algoritmi che lo governano, che di fatto regolano il comportamento collettivo o spingono le persone in una direzione preferenziale»[42][43].

Nei primi mesi del 2018 è scoppiato lo scandalo Facebook: una società che analizza Big Data, Cambridge Analytica, ha usato i dati personali di 87 milioni di utenti della rete sociale a scopo di propaganda politica[44]. Nello scandalo, è emerso che la società britannica abbia utilizzato i big data per influenzare le persone in occasione di elezioni in diversi Paesi anche per il presidente degli Stati Uniti tenutesi nel novembre 2016. Facebook è stato accusato degli standard morali che le società di social networking avrebbe dovuto seguire e della maggiore protezione dei media online e della privacy che ogni utente online dovrebbe avere[Frase poco chiara.][45]. Pertanto, nell'aprile 2018 Facebook ha pagato una multa di 5 miliardi di dollari e dovuto applicare alla propria piattaforma il regolamento generale sulla protezione dei dati.

Virtualizzazione dei Big Data[modifica | modifica wikitesto]

La virtualizzazione dei Big Data è un modo per raccogliere dati da poche fonti in un singolo livello. Il livello dati raccolto è virtuale. A differenza di altri metodi, la maggior parte dei dati rimane sul posto e viene presa su richiesta direttamente dai sistemi di origine.[46]

Note[modifica | modifica wikitesto]

- ^ Voce 3551299 nella IATE.

- ^ Analisi dei megadati per principianti, su CORDIS, 26 giugno 2018. URL consultato il 26 marzo 2024.

- ^ Colmare il divario tra l’innovazione nel campo dei megadati e la protezione dei dati attenta alla privacy, su CORDIS, 3 febbraio 2021. URL consultato il 26 marzo 2024.

- ^ (EN) Andrea De Mauro, Marco Greco e Michele Grimaldi, A Formal definition of Big Data based on its essential features, in Library Review, vol. 65, n. 3, 2016, pp. 122-135, DOI:10.1108/LR-06-2015-0061. URL consultato il 25 giugno 2017.

- ^ Alberto Sardi, Enrico Sorano, Valter Cantino, Patrizia Garengo, Big data and performance measurement research: trends, evolution and future opportunities, in Measuring Business Excellence, 2020, DOI:10.1108/MBE-06-2019-0053.

- ^ Marco Russo, Luca De Biase, Che cosa pensereste se vi dicessero che in Italia i Big Data non esistono?, su blog.debiase.com. URL consultato il 28 ottobre 2014.

- ^ (EN) Jacobs, A., The Pathologies of Big Data, su queue.acm.org, ACMQueue, 6 luglio 2009. URL consultato il 21 ottobre 2013.

- ^ Gianluca Ferrari, Il vero significato dei "Big data", su searchcio.techtarget.it, 14 giugno 2011. URL consultato il 21 ottobre 2013.

- ^ Snijders, C., Matzat, U., & Reips, U.-D. (2012). ‘Big Data’: Big gaps of knowledge in the field of Internet. International Journal of Internet Science, 7, 1-5. International Journal of Internet Science, Volume 7, Issue 1 Archiviato il 23 novembre 2019 in Internet Archive.

- ^ De Mauro, Andrea., Big data analytics : guida per iniziare a classificare e interpretare dati con il machine learning, Apogeo, 2019, ISBN 9788850334780, OCLC 1065010076. URL consultato il 10 novembre 2019.

- ^ Douglas Laney, 3D Data Management: Controlling Data Volume, Velocity and Variety (PDF), su blogs.gartner.com, Gartner. URL consultato il 6 febbraio 2001 (archiviato dall'url originale il 23 luglio 2013).

- ^ Mark Beyer, Gartner Says Solving 'Big Data' Challenge Involves More Than Just Managing Volumes of Data, su gartner.com, Gartner. URL consultato il 13 luglio 2011 (archiviato il 10 luglio 2011).

- ^ a b (EN) Mark Beyer, Gartner Says Solving 'Big Data' Challenge Involves More Than Just Managing Volumes of Data, su gartner.com, 27 giugno 2011. URL consultato il 25 giugno 2017 (archiviato il 10 luglio 2011).

- ^ a b (EN) What is Big Data?, su villanovau.com, Villanova University.

- ^ a b (EN) IBM, The Four V's of Big Data, su ibmbigdatahub.com, ibm, 24 agosto 2012. URL consultato il 25 giugno 2017 (archiviato dall'url originale il 13 luglio 2017).

- ^ a b c (EN) Why only one of the 5 Vs of big data really matters, in IBM Big Data & Analytics Hub. URL consultato il 18 agosto 2017.

- ^ a b (EN) The 5 Vs of Big Data - Watson Health Perspectives, in Watson Health Perspectives, 17 settembre 2016. URL consultato il 18 agosto 2017.

- ^ (EN) Data Veracity, su datasciencecentral.com. URL consultato il 16 agosto 2017 (archiviato dall'url originale il 17 agosto 2017).

- ^ Big Data, su assoknowledge.org, ASSOKNOWLEDGE Confindustria Servizi Innovativi e Tecnologici. URL consultato il 9 giugno 2018 (archiviato il 9 giugno 2018).

- ^ BIG DATA, su logisticaefficiente.it. URL consultato il 9 giugno 2018 (archiviato il 9 giugno 2018).

- ^ Big Data, su multimac.it. URL consultato il 9 giugno 2018 (archiviato il 9 giugno 2018).

- ^ (EN) Andrea De Mauro, Marco Greco e Michele Grimaldi, Understanding Big Data Through a Systematic Literature Review: The ITMI Model, in International Journal of Information Technology & Decision Making, vol. 18, n. 04, 2019-7, pp. 1433-1461, DOI:10.1142/S0219622019300040. URL consultato il 10 novembre 2019.

- ^ Allard J. van Altena, Perry D. Moerland e Aeilko H. Zwinderman, Understanding big data themes from scientific biomedical literature through topic modeling, in Journal of Big Data, vol. 3, n. 1, 15 novembre 2016, p. 23, DOI:10.1186/s40537-016-0057-0. URL consultato il 10 novembre 2019.

- ^ (EN) Elisabetta Raguseo, Big data technologies: An empirical investigation on their adoption, benefits and risks for companies, in International Journal of Information Management, vol. 38, n. 1, 2018-2, pp. 187-195, DOI:10.1016/j.ijinfomgt.2017.07.008. URL consultato il 23 ottobre 2019.

- ^ (EN) Economist, Data, data everywhere, su economist.com.

- ^ (EN) M. Hilbert e P. Lopez, The World's Technological Capacity to Store, Communicate, and Compute Information, in Science, vol. 332, n. 6025, 1º aprile 2011, pp. 60-65, DOI:10.1126/science.1200970. URL consultato il 10 novembre 2019.

- ^ a b I Big Data vi parlano. Li state ascoltando? (PDF), su italy.emc.com, EMC, 2012. URL consultato il 22 ottobre 2013.

- ^ a b (EN) Billings S.A. "Nonlinear System Identification: NARMAX Methods in the Time, Frequency, and Spatio-Temporal Domains". Wiley, 2013

- ^ (FR) Delort P., Big data Paris 2013

- ^ (FR) Delort P., Big Data car Low-Density Data? La faible densité en information comme facteur discriminant

- ^ (EN) Rasetti M., Merelli E., The Topological Field Theory of Data: a program towards a novel strategy for data mining through data language

- ^ Alessandro Piva, Come impostare un progetto di Big Data Analytics?. URL consultato il 21 giugno 2018.

- ^ (EN) Han Hu, Yonggang Wen, Tat-Seng Chua e Xuelong Li, Toward Scalable Systems for Big Data Analytics: A Technology Tutorial, in IEEE Access, vol. 2, 2014, pp. 652-687, DOI:10.1109/ACCESS.2014.2332453.

- ^ (EN) Chen, Min and Mao, Shiwen and Liu e Yunhao, Big Data: A Survey, in Mobile Networks and Applications, vol. 19, 2014, pp. 171-209, DOI:10.1007/s11036-013-0489-0.

- ^ (EN) Nasser Thabet e Tariq Rahim Soomro, Big Data Challenges, in Journal of Computer Engineering & Information Technology}, 2015, DOI:10.4172/2324-9307.1000133.

- ^ (EN) James R. Evans e Carl H. Lindner, Business Analytics: The Next Frontier for Decision Sciences, in Decision Lines, vol. 43, n. 2.

- ^ https://www.mdirector.com/it/marketing-digitale/cos-e-un-data-lake.html

- ^ https://www.uio.no/studier/emner/sv/oekonomi/ECON4135/h09/undervisningsmateriale/FinancialModelersManifesto.pdf

- ^ Cathy O'Neill, Weapons of Math destruction, Penguins Book, 2016; Armi di distruzione matematica, Come i Big Data aumentano la disuguaglianza e minacciano la democrazia, Bompiani, 2016, ISBN 978-88-452-9421-1.

- ^ Domenico Talia, La società calcolabile e i Big Data, Rubbettino, 2018, ISBN 978-8849851823

- ^ http://www.lsoft.com/resources/optinlaws.asp

- ^ Kevin Kelly, The Inevitable (2016), L'inevitabile, le tendenze tecnologiche che rivoluzioneranno il nostro futuro (2017) Milano, Il Saggiatore, trad. Alberto Locca, ISBN 978-88-428-2376-6, pag. 94.

- ^ Yuval Noah Harari, Why Technology Favors Tyranny, in The Atlantic, 2018-10. URL consultato l'11 marzo 2019.

- ^ https://www.ilfattoquotidiano.it/2018/04/04/facebook-zuckerberg-testimoniera-alla-commissione-usa-l11-aprile-sul-caso-cambridge-analytica/4270478/

- ^ The Cambridge Analytica scandal changed the world – but it didn't change Facebook, su theguardian.com.

- ^ (EN) What is Data Virtualization?, su datawerks.com. URL consultato il 27 aprile 2018 (archiviato dall'url originale il 10 aprile 2018).

Bibliografia[modifica | modifica wikitesto]

- Andrea De Mauro, Big Data Analytics. Analizzare e interpretare dati con il machine learning, ISBN 978-8850334780, Apogeo, 2019.

- Marco Delmastro, Antonio Nicita, Big Data. Come stanno cambiando il nostro mondo, Il Mulino, 2019.

- Stefano Mannoni, Guido Stazi, Is Competition A Click Away? Sfida al monopolio nell'era digitale, Editoriale scientifica 2018.

- Viktor Mayer-Schonberger, Kenneth Cukier, Big Data: A Revolution That Will Transform How We Live, Work and Think, John Murray Publishers Ltd, 2013; Big data. Una rivoluzione che trasformerà il nostro modo di vivere e già minaccia la nostra libertà, Garzanti, 2013, ISBN 978-8811682479.

- Marc Dugain, Christophe Labbé, L'uomo nudo. La dittatura invisibile del digitale, ISBN 978-88-99438-05-0, Enrico Damiani Editore, 2016.

- Alessandro Rezzani, Big data. Architettura, tecnologie e metodi per l'utilizzo di grandi basi di dati, ISBN 978-8838789892, Apogeo Education, 2013.

- Cathy O'Neill, Weapons of Math destruction, Penguins Book, 2016; Armi di distruzione matematica, Come i Big Data aumentano la disuguaglianza e minacciano la democrazia, Bompiani, 2016, ISBN 978-88-452-9421-1.

Voci correlate[modifica | modifica wikitesto]

- Analisi dei dati

- Big data analytics

- Data warehouse

- Business intelligence

- Data mining

- Machine learning

- NoSQL

- Apache Hadoop

- MapReduce

- Internet delle cose

- Cookie

- Cloud computing

- Privacy

- Open Data

- Serie storiche

- Profilazione dell'utente

- Cambridge Analytica

Altri progetti[modifica | modifica wikitesto]

Wikizionario contiene il lemma di dizionario «big data»

Wikizionario contiene il lemma di dizionario «big data» Wikimedia Commons contiene immagini o altri file sui big data

Wikimedia Commons contiene immagini o altri file sui big data

Collegamenti esterni[modifica | modifica wikitesto]

- big data, su Vocabolario Treccani, Istituto dell'Enciclopedia Italiana, 2012.

- Big data, su sapere.it, De Agostini.

- Big Data Analytics Training Institute in Hyderabad, India | TechnoIdentity

| Controllo di autorità | Thesaurus BNCF 56394 · LCCN (EN) sh2012003227 · GND (DE) 4802620-7 · BNE (ES) XX5324756 (data) · BNF (FR) cb16657853j (data) · J9U (EN, HE) 987007593186405171 · NDL (EN, JA) 001147262 |

|---|