Rete di Hopfield

Una rete di Hopfield è un tipo di rete neurale artificiale, nota per essere il modello di rete che simula le capacità del cervello umano di ricordare le cose o di ricostruire le immagini distorte.

Nel campo delle reti neurali questo modello è classificato come apprendimento non supervisionato: la rete impara senza avere esempi, soltanto con l'uso del concetto di "energia". Questo modello fa uso delle funzioni di Ljapunov per provare la propria stabilità.

Storia[modifica | modifica wikitesto]

Nel 1982, il fisico americano John Hopfield[1] pubblica un articolo fondamentale in cui presenta un modello matematico comunemente noto appunto come rete di Hopfield: tale rete si distingue per "l'emergere spontaneo di nuove capacità computazionali dal comportamento collettivo di un gran numero di semplici elementi d'elaborazione". Le proprietà collettive del modello producono una memoria associativa per il riconoscimento di configurazioni corrotte e il recupero di informazioni mancanti. Un esempio di memoria associativa è anche la nostra capacità di riconoscere un'immagine anche quando questa non è esatta,[2][3] come il guardare una scritta da una finestra sporca e essere comunque capaci di riconoscerla, o il riconoscere un vecchio amico rivedendolo dopo anni.

Inoltre, Hopfield ritiene che ogni sistema fisico possa essere considerato come un potenziale dispositivo di memoria, qualora esso disponga di un certo numero di stati stabili, i quali fungano da attrattori per il sistema stesso. Sulla base di tale considerazione, egli si spinge a formulare la tesi secondo cui la stabilità e la collocazione di tali attrattori sono proprietà spontanee di sistemi costituiti, come accennato, da considerevoli quantità di neuroni reciprocamente interagenti. Di solito, queste proprietà sono chiamate proprietà emergenti.

Funzionamento[modifica | modifica wikitesto]

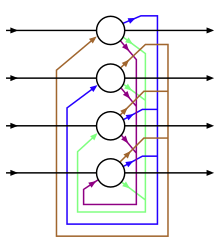

Le applicazioni delle reti di Hopfield riguardano principalmente la realizzazione di memorie associative, resistenti all'alterazione delle condizioni operative, e la soluzione di problemi d'ottimizzazione combinatoriale come, ad esempio, riconoscere la targa di un'auto.[4] Da un punto di vista strutturale, la rete di Hopfield costituisce una rete neurale ricorsiva simmetrica, di cui è garantita la convergenza.

Una rete ricorsiva è un modello neurale in cui è presente un flusso bidirezionale d'informazioni;[2] in altri termini, mentre nelle reti di tipo feedforward, come le reti feedforward neural network, la propagazione dei segnali avviene unicamente, in maniera continua, nella direzione che conduce dagli ingressi alle uscite, nelle reti ricorsive tale propagazione può anche manifestarsi da uno strato neurale successivo ad uno precedente, oppure tra neuroni appartenenti ad uno stesso strato, e persino tra un neurone e sé stesso, chiamato di feedback.

Note[modifica | modifica wikitesto]

- ^ ALON, Uri. An Introduction to systems biology: design principles of biological circuits. Chapman & Hall/CRC, 2006

- ^ a b HAYKIN , Simon . Neural Networks - A Comprehensive Foundation. Second edition. Pearson Prentice Hall: 1999.

- ^ MÜLLER, B. ; REINHARDT, J. ; STRICKLAND, M. T. Neural Networks: an Introduction. The physics of Neural Networks. Spring. Second edition updated and corrected. 1995.

- ^ Gurjinder Pal Singh , Navneet bawa. Vehicle Plate Extraction and Recognition using Hopfield Neural Network and Comparison with DWT, Correlation and NN Algorithms. International Journal of Application or Innovation in Engineering & Management (IJAIEM). Volume 4, Issue 5, May 2015

Bibliografia[modifica | modifica wikitesto]

- Memorie associative e reti di Hopfield (JPG), in MCmicrocomputer, n. 105, Roma, Technimedia, marzo 1991, pp. 282-285, ISSN 1123-2714.

- (EN) J. J. Hopfield, Neural networks and physical systems with emergent collective computational abilities, in Proceedings of the National Academy of Sciences of the USA, vol. 79 no. 8 pp. 2554–2558, April 1982.

- (EN) Hebb, D.O. (1949). Organization of behavior. New York: Wiley

- (EN) Hertz, J., Krogh, A., & Palmer, R.G. (1991). Introduction to the theory of neural computation. Redwood City, CA: Addison-Wesley.

- (EN) McCullough, W.S., & Pitts, W.H. (1943). A logical calculus of the ideas immanent in nervous activity. Bulletin of Mathematical Biophysics,5, 115-133

- (EN) Polyn, S.M., & Kahana, M.J. (2008). Memory search and the neural representation of context. Trends in Cognitive Sciences, 12, 24-30.

- (EN) Rizzuto, D.S., & Kahana, M.J. (2001). An autoassociative neural network model of paired-associate learning. Neural Computation, 13, 2075-2092.

- (EN) Kruse, Borgelt, Klawonn, Moewes, Russ, Steinbrecher (2011). Computational Intelligence.

Voci correlate[modifica | modifica wikitesto]

Altri progetti[modifica | modifica wikitesto]

Wikimedia Commons contiene immagini o altri file su rete di Hopfield

Wikimedia Commons contiene immagini o altri file su rete di Hopfield

Collegamenti esterni[modifica | modifica wikitesto]

- (EN) The Hopfield model (PDF), su page.mi.fu-berlin.de. (EN) Raul Rojas, Neural Networks - A Systematic Introduction, ISBN 978-3-540-60505-8.

- (EN) Hopfield Neural Network Applet, su heatonresearch.com. URL consultato il 15 aprile 2016 (archiviato dall'url originale il 21 maggio 2013).

- (EN) Hopfield Neural Network implementation in Ruby (AI4R), su ai4r.org.

- (EN) The Travelling Salesman Problem, su to-campos.planetaclix.pt. URL consultato il 15 aprile 2016 (archiviato dall'url originale il 30 maggio 2015). Hopfield Neural Network JAVA Applet

- (EN) John Hopfield, Hopfield network, su scholarpedia.org.

- (EN) Hopfield Network Learning Using Deterministic Latent Variables (PDF), su tristanfletcher.co.uk. URL consultato il 15 aprile 2016 (archiviato dall'url originale il 5 ottobre 2011). Tutorial by Tristan Fletcher

- (EN) Neural Lab Graphical Interface, su gna.org. URL consultato il 15 aprile 2016 (archiviato dall'url originale il 25 ottobre 2012). Hopfield Neural Network graphical interface (Python & gtk)